Microsoft está trabajando en una nueva Inteligencia Artificial: VALL-E. Se trata de una herramienta capaz de clonar la voz de alguien a partir de un audio de 3 segundos. Te contamos más en ¡esta nota!

Parece que Microsoft está a full con los sistemas de Inteligencia Artificial. Hace poco se dio a conocer que el gigante tecnológico planeaba invertir $10 mil millones de dólares en ChatGPT de OpenAI. Sin embargo, ahora el gigante de Redmond está trabajando en VALL-E, una herramienta que puede clonar la voz de alguien a partir de un audio de 3 segundos.

Según un artículo publicado por la Universidad de Cornell, los desarrolladores que presentaron a VALL-E explicaron que la herramienta está entrenada con 60.000 horas de habla en inglés. Con esto, la IA es capaz de imitar una voz en “escenarios de tiro cero“, lo que significa que puede hacer que una voz diga palabras que nunca antes había escuchado decir.

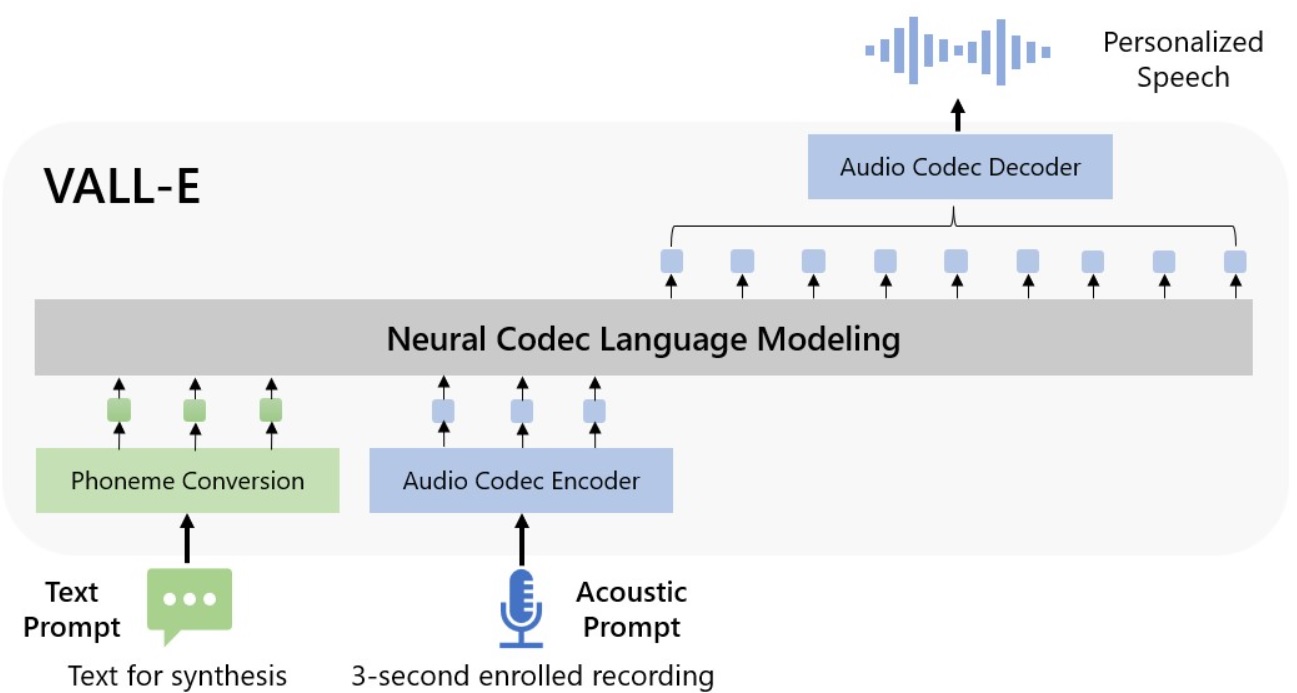

El documento de 16 páginas describe que VALL-E utiliza tecnología de texto a voz para convertir palabras escritas en palabras habladas en discursos “personalizados de alta calidad“. Para hacer esto y realizar su muestreo, la IA usó grabaciones de más de 7.000 oradores reales de LibriLight (un conjunto de datos de audiolibros compuesto por textos de dominio público leídos por voluntarios).

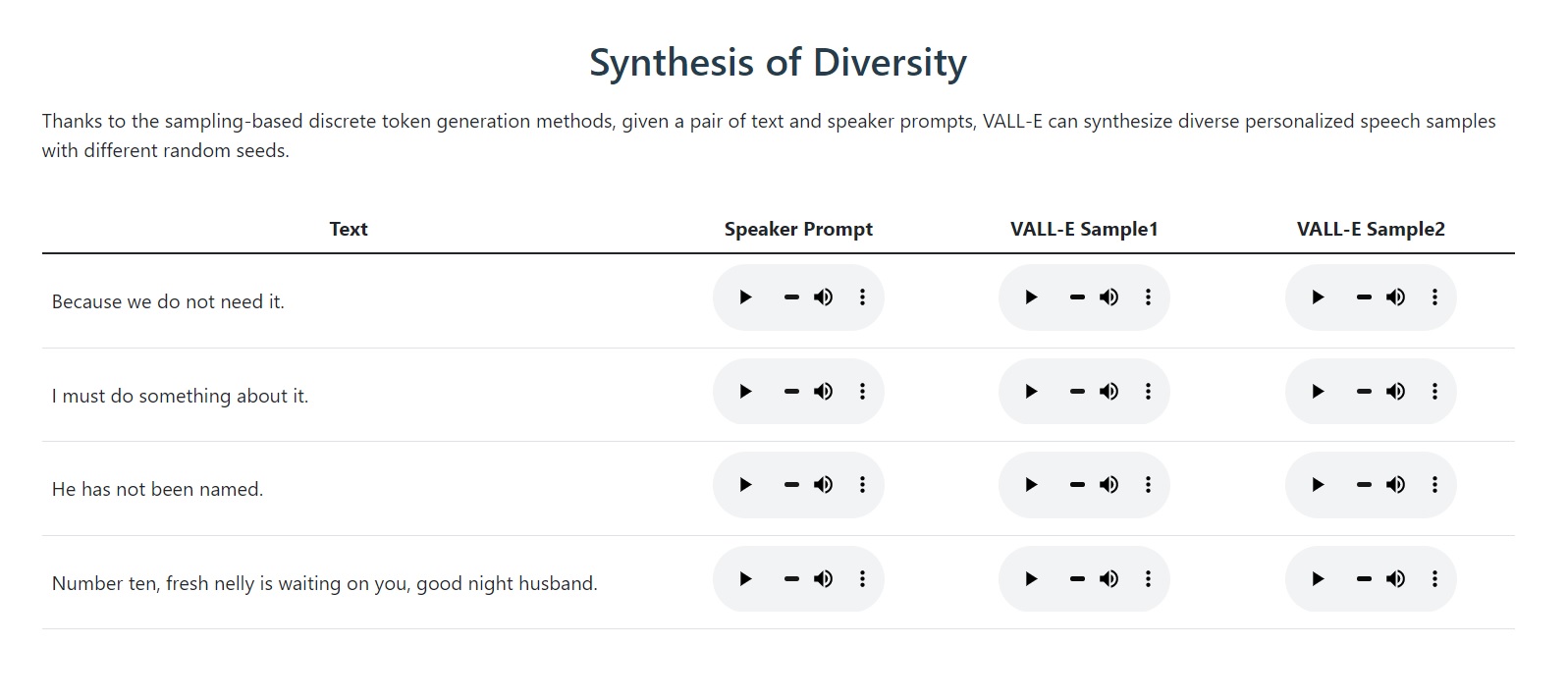

Microsoft publicó en una página muestras de cómo funcionaría VALL-E y cómo se clona la voz de un hablante. Por un lado se ve el texto que los desarrolladores quieren que diga la IA, mientras que por el otro se ven los audios. El primero es el del voluntario, que justamente no dice nada relacionado al texto que está al lado, y el segundo es el de VALL-E, donde dice (en el mismo tono que el audio anterior) lo que dice la oración.

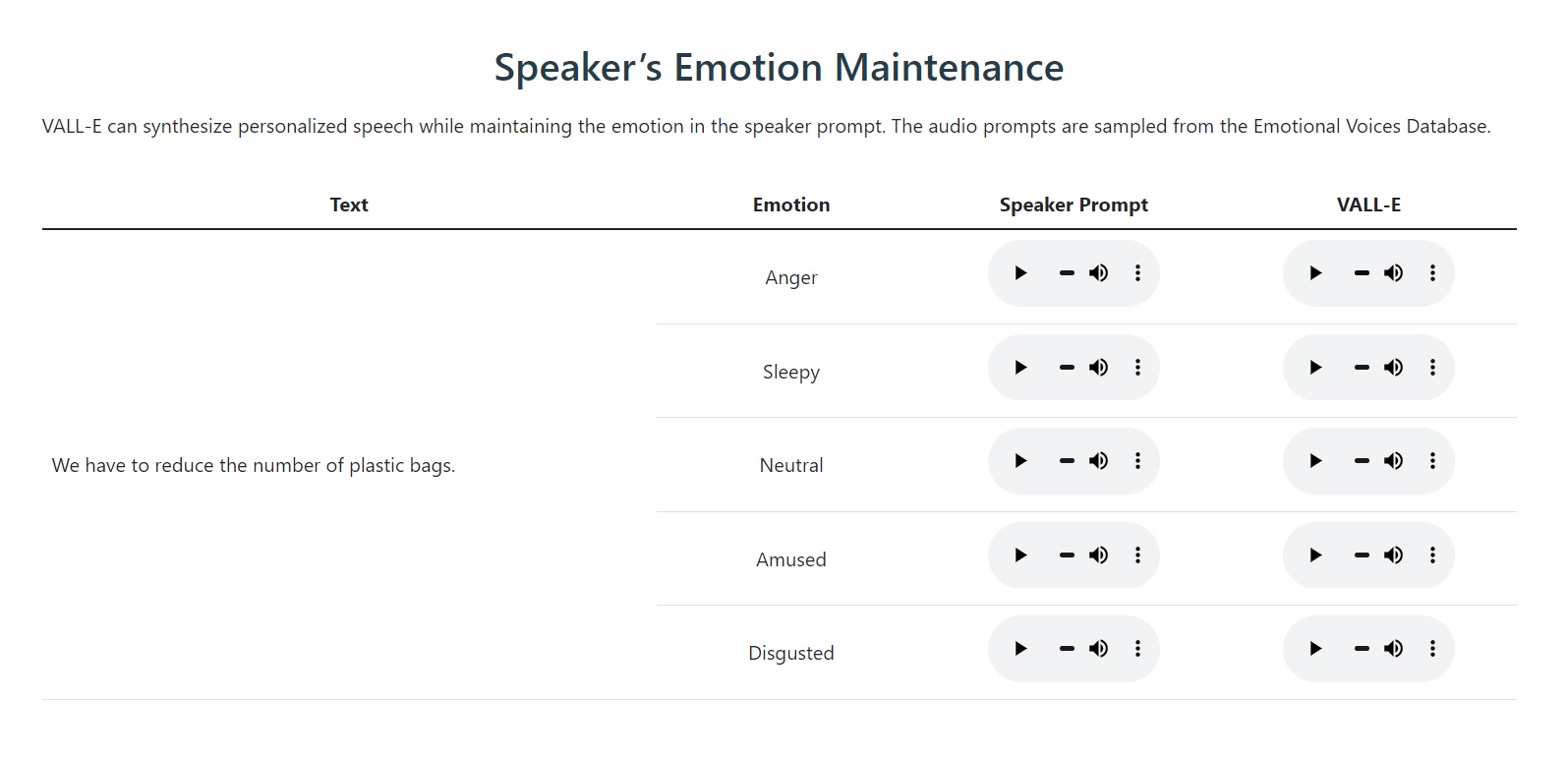

Además de eso, esta Inteligencia Artificial puede sintetizar un discurso personalizado mientras mantiene la emoción de la persona que está hablando. En caso de que te estés preguntando cómo se usa y en dónde, lamentamos informales que la herramienta de Microsoft todavía no está disponible para el público. Es más, ni siquiera se sabe cuál es su propósito.

Los investigadores dijeron que los resultados hasta ahora mostraron que VALL-E “supera significativamente” a los sistemas más avanzados de su tipo, “en términos de naturalidad del habla y similitud del hablante“. Sin embargo, también dejaron en claro que a la herramienta le faltan diversidad de acentos entre los hablantes y que algunas palabras en el discurso sintetizado eran “poco claras, perdidas o duplicadas”.

Además de todo esto, en la página incluyeron una advertencia ética sobre VALL-E y sus riesgos, ya que (al igual que otras tantas IA) podría usarse indebidamente, como por ejemplo para “falsificar la identificación de voz o hacerse pasar por un hablante específico“. También agregaron que “si el modelo se generaliza a hablantes invisibles en el mundo real, debe incluir un protocolo para garantizar que el hablante apruebe el uso de su voz”.

Para mitigar los posibles riesgos al usar esta herramienta, los desarrolladores dijeron que “es posible construir un modelo de detección para discriminar si un audio fue sintetizado por VALL-E“. Sin embargo, no dieron detalles de cómo se podría hacer esto.