Uno de los nuevos servicios de Google es la IA que convierte cualquier texto que le propongamos, por más loco que sea, en una imagen. Te contamos como funciona ¡En esta nota!

Estos últimos meses se volvió una tendencia bastante interesante las Inteligencias Artificiales que puede generar una imagen en base a un texto, y Google no se quiso quedar atrás. Por esto es que estrenó su propia IA. En un principio, una de las páginas que se hizo más conocida fue Wombo.ar, página que nos permite escribir cualquier frase o palabra y la convierte en un dibujo hecho en el estilo de arte de nuestra preferencia.

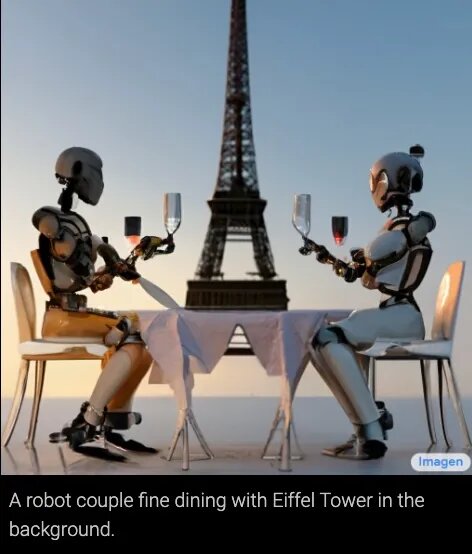

Sin embargo, existen otros tipos de IA que generan imágenes en base a lo que escribamos. Estas son las que crean la imagen de lo que nosotros queramos. Por ejemplo, si queremos una foto de un perro con un casco de astronauta, lo escribimos en la plataforma de cada IA y nos va a dar la imagen en cuestión de segundos. Una de las más reconocidas es DALL-E, creada por el laboratorio OpenAI y que recibió una actualización en abril de este año.

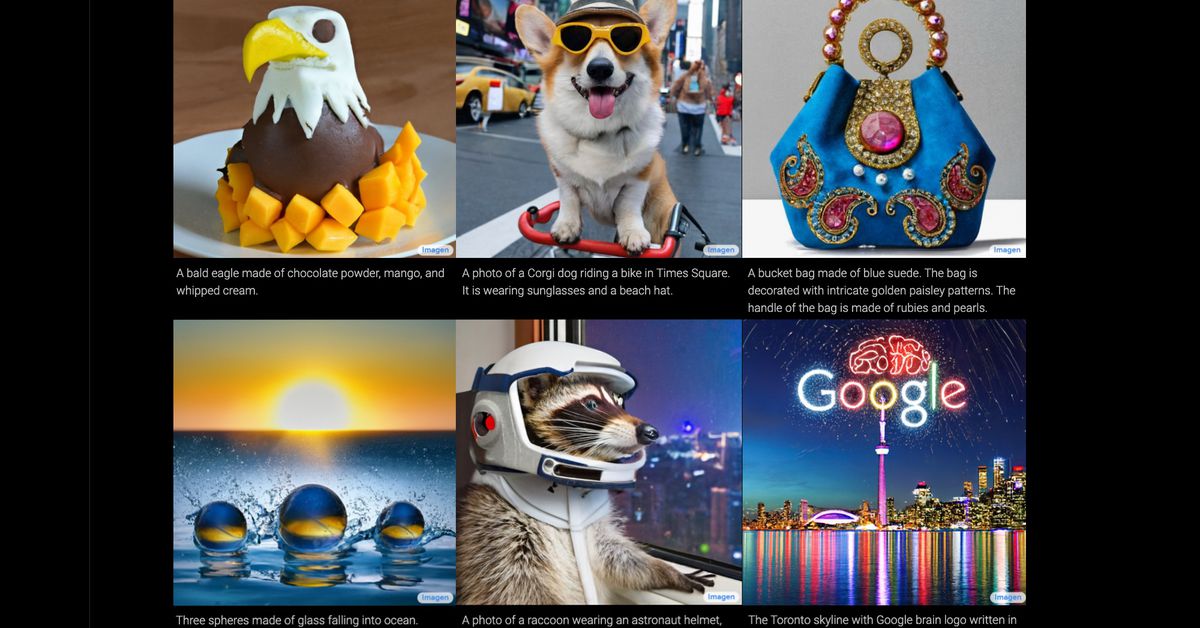

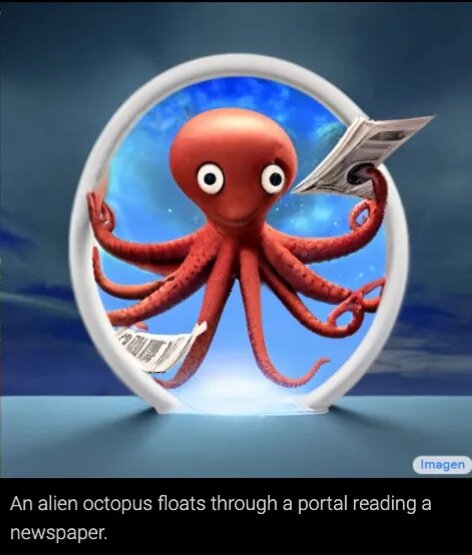

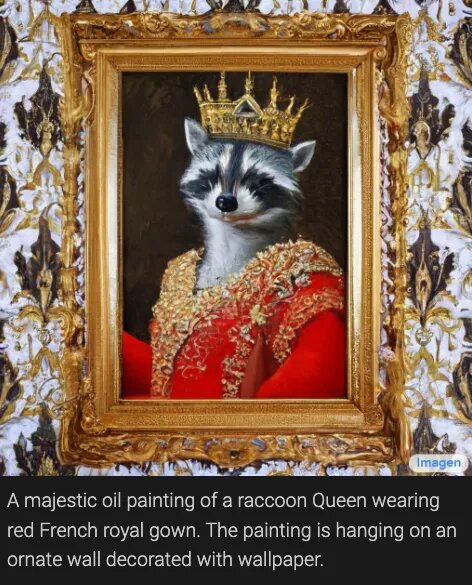

Ahora Google quiere sumarse a esta moda y presentó su propia Inteligencia Artificial llamada Imagen, que parece ser un poco superior a DALL-E. Imagen usa el texto que queremos transformar y nos da literalmente lo que le pedimos en forma de foto. Por ejemplo, en la foto de arriba la frase fue “un pulpo alienigena que flota a través de un portal mientras lee un diario”. Y la IA de Google nos dio literalmente eso.

Puede que estas imágenes sean impresionantes y bastante precisas, hay que considerar que las imágenes que se presentaron son solo las que mejor salieron y estuvieron creadas bajo la atenta mirada (y quizás manipulación) de sus creadores. Cuando se lanza un nuevo modelo de IA, el equipo de Google Brain tiende a elegir los mejores resultados para que la gente quede con ganas de más. Si bien todas estas fotos tienen una alta calidad, es posible que no todas las que se creen salgan con esta resolución.

Lo que suele pasar con las imágenes creadas por los modelos de texto a imagen suelen verse como si no estuvieran terminadas, borrosas o manchadas. Esto pasó con algunas de las imágenes generadas por DALL-E de OpenAI que puede tener tendencia de no entender completamente la frase que se le ofrecía.

Según Google, su IA es capaz de producir imágenes mucho más consistentes que el DALLE-2. Esto es de acuerdo al nuevo punto de referencia que Google creo para este proyecto, llamado DrawBench. Lo bueno es que no es una métrica particularmente compleja: tiene una lista de 200 indicaciones de texto que el equipo de Google introdujo en Imagen y otros generadores de texto a imagen. Luego, cada resultado que tiraba cada IA era juzgado por algún evaluador humano.

A pesar de esto, no podemos experimentar con Imagen ya que Google no lanzó la IA para el público. La razón principal por la que la compañía decidió hacer es bastante interesante. Si todos tenemos acceso a una tecnología que nos permite crear imágenes con una simple frase, y más si podemos poner cualquier cosa, Imagen puede llegar a ser utilizado para crear, por ejemplo, fake news.

En cuanto a como se entrenó esta IA, Google explicó que se le incorporó un montón de información. Principalmente, se levantaban imágenes de internet que tuvieran una descripción. Sin embargo, los encargados detrás de Imagen también comentaron que tuvieron que poner un filtro ya que como la IA se alimenta de todas las imágenes que levanta de internet que tienen una descripción, se podían llegar a encontrar imágenes que fomentaran los estereotipos o la discriminación.

A pesar de que en el informe Google no explica bien los problemas de Imogen, si señala que el modelo “codifica varios sesgos y estereotipos sociales, incluido un sesgo general hacia la generación de imágenes de personas con tonos de piel más claros y una tendencia a imágenes que retratan diferentes profesionales para alinearse con los estereotipos del género occidentales”.

Pero este no es solo un problema de la IA de Google, ya que DALLA-E también tiene este problema. Si se le pide a DALLA-E que nos genere imágenes de un auxiliar de vuelo, por ejemplo, la mayoría de las imágenes que recibiremos serán de una mujer. Si ponemos la palabra CEO recibiremos, para sorpresa de nadie, muchas imágenes del típico hombre exitoso de tez blanca.

Estas son las principales razones por las que estos tipos de IA no se encuentran disponibles para todo el público. DALLA-E tampoco ofrece sus servicios a todo el mundo, aunque si los ofrece a unos testeadores Beta. La versión Beta, sin embargo, filtra algunos textos que se escriban y no generará imágenes de frases racistas, sexuales ni violentas.

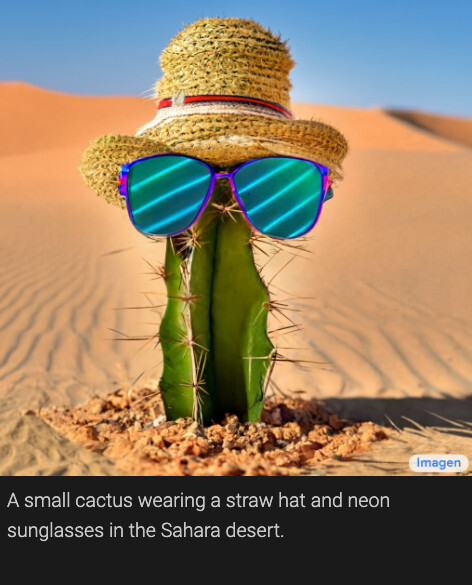

Probablemente en algún momento podremos acceder a este tipo de IA. Google, por su parte, confirmó que no está en sus planes que salga para acceso público Imagen por ahora. La compañía también dice que planea desarrollar una nueva forma de comparar “sesgo social y cultural en el trabajo futuro” y probar iteraciones futuras. Por el momento, tendremos que conformarnos con los imágenes que sacó Google. Aunque no nos quejamos ya que tenemos a un cactus con sombrero y anteojos y a una reina mapache. [embedyt] https://www.youtube.com/watch?v=6NbpzkujuQw[/embedyt]